ISABEL RUBIO ARROYO | Tungsteno

El reconocimiento facial tiene el potencial de identificar espías o personas muertas y ayudar a refugiados a reunirse con sus familias en las guerras, pero también conlleva algunos riesgos con consecuencias catastróficas. Ante la invasión rusa, el Ministerio de Defensa de Ucrania ha recurrido a una base de datos de 20.000 millones de rostros de la empresa Clearview AI. Tras examinar cómo los satélites mapean el conflicto de Ucrania y qué tecnologías ayudan a sustituir el gas de Rusia, analizamos los pros y los contras del uso del reconocimiento facial en conflictos bélicos.

Tecnología para verificar identidades en la guerra

Cuando Rusia invadió Ucrania, el director ejecutivo de Clearview AI comenzó a pensar cómo podía ayudar en el conflicto. “Recuerdo haber visto videos de soldados rusos capturados y a Rusia afirmando que eran actores”, afirma Hoan Ton-That al periódico The New York Times. Fue entonces cuando pensó que con su tecnología de reconocimiento facial, los ucranianos podrían verificar la identidad de posibles espías y de personas fallecidas, además de ayudar a reunir a los refugiados con sus familias.

Tras ofrecer los servicios de Clearview AI a Ucrania de forma gratuita, creó más de 200 cuentas para usuarios en cinco agencias gubernamentales de este país y tradujo su aplicación a su idioma. Desde entonces, Ucrania ha utilizado esta tecnología para identificar a los soldados rusos, vivos o muertos, y para verificar que los viajeros en Ucrania son quienes afirman ser. Entre las estrategias de este país, está la de identificar a soldados muertos y avisar a sus familias. El viceprimerministro ucraniano, Mykhailo Fedorov, considera que es la mejor forma de hacer llegar al público ruso el coste del conflicto y “disipar el mito de una 'operación especial en la que 'no hay conscriptos' y 'nadie muere'”.

Ucrania utiliza reconocimiento facial para identificar a soldados rusos muertos. Crédito: DW Shift.

Unas 14 fotos por cada persona en la Tierra

En palabras de su creador, Clearview AI sería algo así como "un motor de búsqueda de rostros". "Funciona como Google. Pero en lugar de poner una cadena de palabras o texto, el usuario busca una foto de una cara", explica Ton-That. A día de hoy, este sistema tiene 20.000 millones de rostros y una amplia base de datos de ciudadanos rusos gracias a VK, el Facebook ruso.

Cada día la empresa recopila más y más imágenes. De hecho, ha indicado a sus inversores que a principios de 2023 espera tener 100.000 millones de fotos de caras, lo suficiente para garantizar que "casi todos en el mundo sean identificables", según una presentación financiera a la que ha tenido acceso The Washington Post. Esas imágenes equivalen a 14 fotos por cada una de las 7.000 millones de personas en la Tierra. Clearview AI explica que todas estas imágenes provienen de páginas web públicas, medios de comunicación, sitios web de fichas policiales, redes sociales públicas y otras fuentes abiertas.

Toda esta información, según la compañía, “permite identificaciones y detenciones más rápidas para ayudar a resolver y prevenir delitos y a que nuestras comunidades sean más seguras”. Pero sus técnicas pueden violar los derechos de privacidad de los usuarios. De hecho, la Agencia de Protección de Datos de Reino Unido (la ICO, por sus siglas en inglés) multó en mayo a Clearview AI con más de 7,5 millones de libras esterlinas (unos 8,7 millones de euros) por recopilar imágenes de Internet para crear una base de datos global de reconocimiento facial. El organismo ha ordenado a la compañía que deje de obtener y utilizar los datos personales de los residentes del Reino Unido que están disponibles de forma pública en la web.

ClearView AI tiene 20.000 millones de rostros y una amplia base de datos de ciudadanos rusos. Crédito: NOVA PBS Official.

Un arma de doble filo

En cuanto a la eficacia del software de reconocimiento facial en las guerras, hay pruebas contradictorias, tal y como indica en The Conversation Felipe Romero Moreno, profesor en la Facultad de Derecho de la Universidad de Hertfordshire. Algunos estudios indican que esta tecnología consigue identificar a personas muertas igual o mejor que un humano. Pero, según el Departamento de Energía de Estados Unidos, la descomposición del rostro de una persona fallecida puede reducir la precisión del programa.

Además, tal y como subraya Romero, algunas investigaciones sugieren que las huellas dactilares, los registros dentales y el ADN siguen siendo las técnicas de identificación más fiables. “Pero son herramientas para profesionales capacitados, mientras que el reconocimiento facial puede ser utilizado por personas que no son expertas”, señala el profesor. También hay que tener en cuenta que esta tecnología a veces falla, por lo que puede emparejar por error dos imágenes o no hacer coincidir las fotos de una misma persona. En Ucrania, las consecuencias de cualquier posible error con la inteligencia artificial podrían ser desastrosas: “Un civil inocente podría morir si se le identifica erróneamente como un soldado ruso”. Desde Clearview AI insisten en que su herramienta debe complementar y en ningún caso reemplazar las tomas de decisiones humanas.

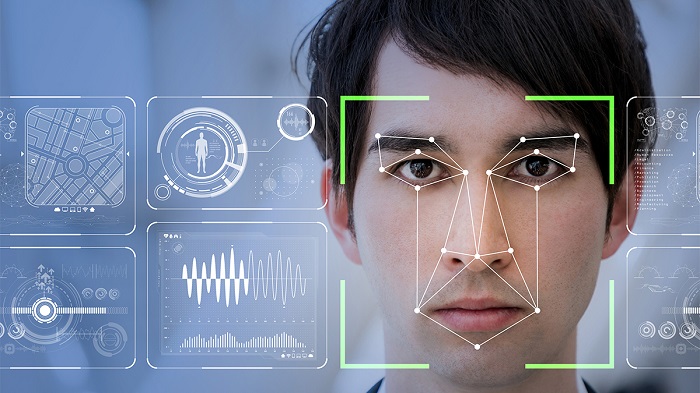

Los sistemas de reconocimiento facial suelen aplicar una serie de sesgos y a veces fallan. Crédito: NEC.

Además, si la tecnología se puede usar para identificar soldados enemigos vivos y muertos, también podría incorporarse a sistemas que usen la toma de decisiones automatizada para dirigir la fuerza letal. Así lo indican los filósofos Darian Meacham y Martin Gak, que investigan la ética en zonas de conflicto: “Esta no es una posibilidad remota”. Mientras que el año pasado, la ONU informó que un dron autónomo podía haber matado a personas en Libia en 2020, hay sospechas de que pueden estarse usando armas autónomas en la guerra de Ucrania.

Pese a que la tecnología de reconocimiento facial tiene un enorme potencial en este tipo de conflictos para identificar a personas, no hay que olvidar todos los riesgos que conlleva. Tal y como subraya en la BBC Conor Healy, experto en reconocimiento facial en el grupo de investigación de vigilancia IPVM, es importante que las fuerzas ucranianas reconozcan que esta “no es una forma 100% precisa de determinar si alguien es su amigo o su enemigo”. “No debería ser una tecnología de vida o muerte en la que apruebas o fallas, donde podrías ser encarcelado o, Dios no lo quiera, incluso asesinado”, concluye.

· — —

Tungsteno es un laboratorio periodístico que explora la esencia de la innovación. Ideado por Materia Publicaciones Científicas para el blog de Sacyr.